今天我们将带大家深入解析美国布朗大学计算机科学系的博士生导师Prof. Bach,通过这样的“方法论”,让大家学会如何从了解一个导师开始,到后期更好地撰写套磁邮件及其他文书。

研究领域解析和深入探讨

教授的研究方向主要集中在“如何通过有效的方式教导计算机”这一主题,涵盖了弱监督学习(weak supervision)、零样本学习(zero-shot learning)和小样本学习(few-shot learning)等关键领域。其研究目标是利用高层次的领域知识,尤其是符号化和语义上有意义的知识,提升计算机的泛化学习能力。

此外,教授的工作紧密结合实际应用,主要涉及以下几个领域:

- 信息提取(Information Extraction)该研究关注通过自动化技术从大量数据中提取结构化信息,应用于文本分析、搜索引擎等领域。

- 图像理解(Image Understanding)通过弱监督学习和视觉语言模型,教授的研究旨在提高计算机对图像内容的理解和描述能力。

- 科学发现(Scientific Discovery)在生物信息学、自然语言处理等领域,教授利用学习技术推动新规律的发现。

- 数据科学(Data Science)研究为大数据分析和模型训练提供创新方法,推动数据科学的进一步发展。

教授特别关注生成训练数据(training data generation)的自动化方法,尤其是在低资源语言和标签稀缺的情境下,提出了多种解决方案,体现了对现实问题的深入思考。

精读教授所发表的文章

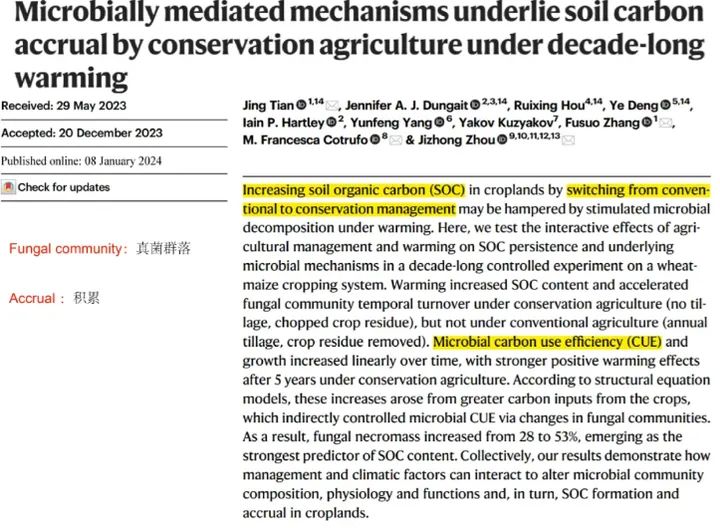

1.Follow-Up Differential Descriptions: Language Models Resolve Ambiguities for Image Classification(ICLR 2024)

这篇文章探讨了语言模型如何通过后续提示(follow-up prompting)技术解决图像分类中的不确定性问题。该研究有助于提升视觉语言模型(如CLIP)的判别能力和应用效果。

2.Does CLIP Bind Concepts? Probing Compositionality in Large Image Models (EACL Findings 2024)

该论文研究了CLIP模型在组合学习方面的能力,探讨了大规模视觉语言模型如何通过组合不同概念,从而推动模型在复杂任务中的应用。

3.Learning to Generate Instruction Tuning Datasets for Zero-Shot Task Adaptation(ACL Findings 2024)

该研究提出了一种生成指令调整数据集的方法,用于零样本任务适应(zero-shot adaptation)。该方法增强了大语言模型在多任务环境下的泛化能力。

4.Low-Resource Languages Jailbreak GPT-4(NeurIPS SoLaR 2023)

本文获得了NeurIPS SoLaR 2023最佳论文奖,探讨了如何利用GPT-4处理低资源语言问题,展示了大语言模型在语言适应性和公平性方面的潜力。

教授的学术地位

教授现为布朗大学计算机科学系助理教授,在机器学习和弱监督学习领域具有广泛的影响力。

以下是教授学术贡献的几个方面:

1.顶级会议发表:教授的研究成果经常出现在国际顶级会议中,如ICLR(International Conference on Learning Representations)、ACL(Association for Computational Linguistics)、NeurIPS(Neural Information Processing Systems)等。

2.工业与学术界应用:教授开发的工具和框架,如Snorkel、WISER、TAGLETS,已广泛应用于工业界和学术界。例如,Snorkel已被谷歌和FDA等机构采纳,推动了实际问题的解决。

3.前沿项目领导:教授主导了多个创新项目,如T0、ZSL-KG,并提出了生成式弱监督学习和知识图谱学习等突破性方法,进一步丰富了机器学习领域的工具和方法。

4.荣誉与认可:教授的研究工作曾荣获NeurIPS SoLaR 2023最佳论文奖,这充分体现了其在学术界的高度认可和影响力。

教授的贡献不仅具有理论创新性,还具备显著的实际应用价值,成为机器学习领域的重要推动者。

有话说

在撰写邮件时,学生应展现出对教授研究方向的深入理解,并结合自身的学术背景提出具有创新性的合作建议。

以下是一些可以参考的思考方向:

1.结合弱监督学习与自身研究背景:

如果学生在自然语言处理或计算机视觉等领域有相关背景,可以提出如何利用教授的WISER或Snorkel框架来解决实际问题,如信息抽取或低资源语言处理。

2.创新应用思路:针对教授的零样本学习与指令调整方法,学生可以探讨其在其他领域的潜在应用,如医疗数据分析、遥感图像分类等。

3.提出学术问题:学生可以根据教授的最新研究,如CLIP模型的组合性或低资源语言建模,提出启发性问题。例如,如何优化提示工程以提高弱监督方法在不同任务中的泛化能力。

4.结合当前研究热点:学生可以结合大语言模型(LLMs)和生成式AI的最新发展,探讨如何利用教授的研究方法提升大模型的训练效率和性能。

博士背景

Aurelia ,美国TOP10院校计算机科学与认知科学双博士生,研究聚焦算法博弈论不确定性及其在人工智能中的应用。她的跨学科研究融合了计算机科学、语言学和心理学知识,在国际顶级期刊《Journal of Artificial Intelligence Research》和《Cognitive Science》上发表多篇论文。Aurelia 荣获ACM SIGAI博士论文奖,擅长相关方向的PhD申请指导。